第10章 多重线性回归分析

1. 多重线性回归分析概述

多重回归与多元回归的区别

- 多重回归 (Multiple Regression):1个因变量 (\(Y\)) 与 多个自变量 (\(X_1, X_2, ..., X_k\))。本章主要讨论此内容。

- 多元回归 (Multivariate Regression):多个因变量 (\(Y_1, Y_2, ...\)) 与多个自变量。

研究目的

- 描述关联:描述多个自变量与因变量之间的线性依存关系。

- 分析影响:从众多自变量中找出有统计学意义的因素,并定量描述其影响大小。

- 预测与控制:根据自变量取值预测 \(Y\) 的范围,或为了控制 \(Y\) 而控制 \(X\) 的范围。

2. 多重线性回归模型的建立

回归模型

-

总体回归模型: $$ Y_i = \beta_0 + \beta_1 X_{1i} + \beta_2 X_{2i} + ... + \beta_k X_{ki} + \epsilon_i $$ 其中 \(\epsilon \sim N(0, \sigma^2)\)。\(\beta_0\) 为常数项,\(\beta_j\) 为偏回归系数。

-

样本回归方程: $$ \hat{Y} = b_0 + b_1 X_1 + b_2 X_2 + ... + b_k X_k $$ 通过最小二乘法求解 \(b_j\),使得残差平方和 \(Q = \sum(Y - \hat{Y})^2\) 最小。\(\hat{Y}\)为在 \(X\) 取某值时,总体均值 \(\mu_{Y|X}\) 的点估计值(预测值)

偏回归系数

- 含义 (\(b_j\)):表示在控制其他自变量保持不变的情况下,自变量 \(X_j\) 每改变一个单位,因变量 \(Y\) 的平均变化量。

- 性质:有单位,其大小受自变量量纲影响,不能直接比较不同变量的贡献大小。

例题:数据变换对系数的影响

多重线性回归分析中,若对某一自变量的值加上一个不为零的常数\(K\),则有( )。

A. 截距和该偏回归系数均不变

B. 该偏回归系数数值为原有偏回归系数数值的\(K\)倍

C. 该偏回归系数数值会改变,但无规律

D. 截距改变,但所有偏回归系数数值均不改变

E. 所有偏回归系数数值均不会改变

正确答案: D

解析: 对自变量做平移变换 (\(X'_j = X_j + K\)) 不改变其与因变量的协变关系(斜率/变化率不变),故偏回归系数不变,但回归直线在Y轴上的截距会相应调整以保持拟合值一致。

标准化偏回归系数

- 定义:对 \(Y\) 和 \(X\) 进行标准化变换(减均数,除以标准差)后求得的回归系数。

- 作用:无量纲。可以直接用来比较各自变量对因变量影响的相对大小(绝对值越大,影响越大)。

例题:变量重要性的衡量

在多重线性回归分析中,不可用来衡量各变量重要性的统计量是( )。

A. 离均差平方和

B. 偏回归平方和

C. 标准化偏回归系数

D. 偏相关系数

E. 偏回归系数假设检验的\(t\)

正确答案: A

解析: 离均差平方和 (\(SS_{总}\)) 反映的是因变量 \(Y\) 自身的总变异,不包含自变量的信息,无法衡量特定自变量的重要性。而 B、C、D、E 均可在不同角度反映自变量对因变量的贡献或关联强度。

3. 回归方程和回归系数的假设检验

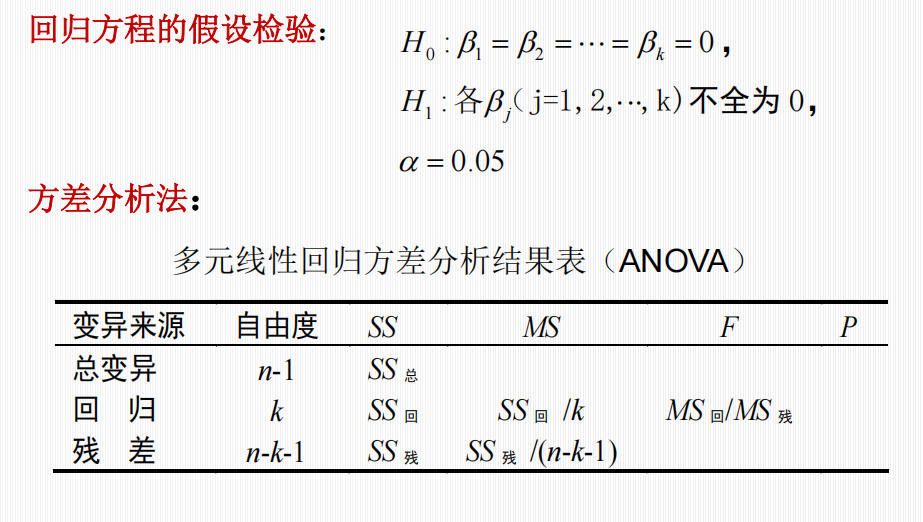

全模型检验 —— 方差分析 (ANOVA)

- 目的:检验整个回归方程是否具有统计学意义。

- 假设:\(H_0: \beta_1 = \beta_2 = ... = \beta_k = 0\)(所有自变量均无效)。

- 统计量: $$ F = \frac{MS_{回归}}{MS_{残差}} = \frac{SS_{回归}/k}{SS_{残差}/(n-k-1)} $$

偏回归系数检验 —— \(t\) 检验

- 目的:检验某一个自变量 \(X_j\) 是否对 \(Y\) 有显著影响。

- 假设:\(H_0: \beta_j = 0\)。

- 统计量:\(t = \frac{b_j}{S_{b_j}}\)。

- 注意:即便全模型 \(F\) 检验显著,不代表每个自变量的 \(t\) 检验都显著。

评价模型的指标

决定系数\(R^2\)

表示回归模型解释了因变量变异的百分比。缺点是自变量越多,\(R^2\) 越大(只增不减)。

校正决定系数\(R_{ad}^2\)

修正了自变量个数对 \(R^2\) 的影响。增加无意义变量时,\(R_{ad}^2\) 可能减小。用于模型比较。 $$ R_{ad}^2 =1-\frac{MS_{残}}{MS_{总}} $$

复相关系数\(R\)

\(R = \sqrt{R^2}\),反映 \(Y\) 与所有自变量的线性相关的密切程度。

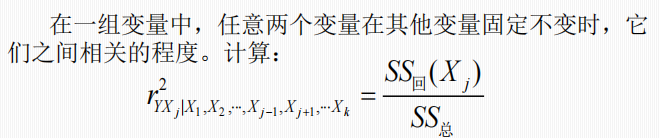

偏相关系数

-

定义:在一组变量中,当其他变量固定不变(被控制)时,任意两个变量之间相关的程度。

-

偏回归平方和 (\(SS_{回}(X_j)\)):

- 衡量在模型中已有其他变量的基础上,增加变量 \(X_j\) 后回归平方和的增加量。

- 计算示例:\(SS_{回}(X_2) = SS_{回}(X_1, X_2, X_3, X_4) - SS_{回}(X_1, X_3, X_4)\)。

-

计算公式: 利用偏回归平方和来计算偏相关系数,反映扣除其他变量影响后的相关占比。

下面算的其实应该是偏确定系数()

-

性质:

- 符号一致性:偏相关系数的符号与对应的偏回归系数(\(b_j\))的符号一致。

- 局限性:仅反映变量间的线性相关性,而不说明因果关系。

偏相关系数与偏回归系数的区别

两者都是在控制其他变量的情况下进行分析,但侧重点不同:

| 指标 | 偏回归系数 | 偏相关系数 |

|---|---|---|

| 含义 | 表示在控制其他变量不变的情况下,一个自变量对因变量的影响程度。 | 表示两个变量在控制其他变量后的线性相关强度。 |

| 几何/统计意义 | 斜率 | 强度/分布 |

| 功能 | 直接量化效应 | 量化相关性 |

例题:决定系数的含义

多重线性回归分析中,能直接反映自变量解释因变量变异百分比的指标为( )。

A. 复相关系数

B. 简单相关系数

C. 确定系数

D. 偏回归系数

E. 偏相关系数

正确答案: C

解析: 确定系数(即决定系数 \(R^2\))表示因变量总变异中可由回归模型解释的比例,即 \(R^2 \times 100\%\) 为解释百分比。

4. 自变量筛选

为了建立“最优”回归方程,需要在模型拟合度和简洁性之间取得平衡。

筛选标准

好的模型应满足: 1. \(R^2\) 或 \(R_{ad}^2\) 较大。

-

残差均方 (\(MS_{残差}\)) 较小。

-

AIC (赤池信息准则) 较小。

-

\(C_p\) 统计量 较小且接近 \(p\)(\(p\) 为自变量个数+1,即参数个数)。

例题:自变量筛选标准

下面关于自变量筛选的统计学标准中错误的是( )。

A. 残差平方和 (\(SS_{残}\)) 缩小

B. 确定系数 (\(R^2\)) 增大

C. 残差的均方 (\(MS_{残}\)) 缩小

D. 调整确定系数 (\(R^2_{ad}\)) 增大

E. \(C_p\) 统计量增大

正确答案: E

解析: \(C_p\) 统计量越小(越接近自变量个数+常数项之和),说明模型拟合越好且偏倚越小。因此“\(C_p\) 增大”不是好的筛选标准,属于错误说法。

筛选方法

- 前进法 (Forward):变量由少到多,逐个引入。

- 后退法 (Backward):先引入所有变量,逐个剔除不显著的。

- 逐步回归法 (Stepwise):结合前进和后退,每引入一个新变量,都对已入选变量进行重新检验,剔除变得不显著的变量。本质上是双向筛选。可以排除多重共线性

5. 应用注意事项与模型诊断

LINE条件

多重线性回归也需要满足 LINE 条件:线性、独立、正态、等方差。需要进行残差分析来检验

下述的OLS估计量为最小二乘法(Ordinary Least Squares, OLS)估计的回归系数。

线性

- 含义:总体均值 \(\mu_{Y|X}\) 与 \(X\) 呈线性关系 。

- 影响:独立性不满足时直接导致估计量有偏 (Biased)。

如果实际关系是非线性的(如抛物线),而你强行用直线去拟合,算出来的斜率 \(b\) 和截距 \(a\) 无法反映真实的变量关系。此时模型设定错误,估计量不再是无偏的,预测也是完全错误的。

独立性

- 含义:任意两个观察值的误差项,互不影响。

独立性不满足时

-

影响:影响有效性 (Efficiency) 和统计推断,通常不影响无偏性。

-

无偏性:OLS 估计量通常仍然是无偏的(即多次抽样的均值还是等于真实值)。

- 有效性:估计量不再是“有效”的(不再是方差最小的最佳估计)。

- 统计推断:标准误 (\(S_b\)) 计算会出错,导致 \(t\) 检验和置信区间失效。

正态性

- 含义:对于给定的 \(X\),对应的 \(Y\) 服从正态分布 。

正态性不满足时

-

影响:影响统计推断 (Inference),不影响无偏性。

-

无偏性:即使不满足正态性,只要满足其他条件,OLS 估计量仍然是无偏的。OLS 的计算只依赖于最小化残差平方和,不需要正态假设。

- 统计推断:这是正态性最主要的作用。如果残差不正态,小样本下 \(t\) 检验和 \(F\) 检验的 P 值可能不准确,置信区间的覆盖率也会有问题(不过在大样本下,根据中心极限定理,影响会减弱)。

等方差性

等方差性不满足时:

无偏性:OLS 估计量仍然是无偏的(回归线依然穿过数据中心)。

有效性:OLS 估计量不再是有效的(方差变大,不是最优估计)。

统计推断:标准误 (\(S_b\)) 估计出现偏差(通常被低估),导致 \(t\) 值虚高,容易得出错误的“显著”结论(假阳性)。

预测精度:预测误差变大,预测失效。

例题:违反等方差性的后果

如果在回归分析时,不满足“LINE”中的等方差,以下说法正确的是( )。

A. 此时,OLS估计量仍然具有无偏性,但不具有有效性或渐进有效性。

B. 参数标准差出现偏误,变量的显著性检验失去意义。

C. 参数OLS估计值的变异程度增大,从而对\(Y\)的预测误差变大,降低预测精度,预测失效

D. 此时,我们从残差分析中可以看到(图略:标准矩形残差图,此项不选)

E. 在研究居民家庭的储蓄额\(Y\)和可支配收入\(X\)的关系时,如果高收入家庭储蓄差异较大,低收入家庭储蓄差异较小,会出现不满足等方差的情况。

正确答案: A, B, C, E

解析: 异方差不影响无偏性,但破坏有效性(方差不再最小),导致标准误估计偏误,影响假设检验和预测精度;收入与储蓄的典型异方差情形也符合E描述。

例题:回归分析综合概念

关于回归分析,以下说法正确的是( )。

A. 如果不满足“LINE”中的“独立”,参数估计量不再具有有效性或渐进有效性

B. 在回归方程中包含的多个自变量中,回归方程自变量个数增加,无论该自变量对因变量贡献大小,决定系数\(R^2\)值不会减小。

C. 在回归分析中,选择自变量可以考虑赤池信息准则(AIC),如果加入一新的变量会使AIC变大,则从这一角度考虑不应加入这一变量。

D. 在回归方程具有统计学意义的情况下,检验某个总体偏回归系数等于零的假设,应当采取\(t\)检验。

E. 如果残差不服从正态分布,那么用最小二乘法得到的回归系数一定是有偏的。

正确答案: A, B, C, D

解析: A、B、C、D均正确描述了回归分析的性质(AIC越小越好;\(R^2\)单调递增;系数用\(t\)检验)。E是错误的,因为正态性假设主要用于假设检验(如\(t\)检验的分布),OLS估计量的无偏性并不依赖于正态分布(只依赖于零均值和外生性)。

多重共线性

- 定义:自变量之间存在较强的线性关系(例如 \(r > 0.9\))。

- 后果:

- 参数估计值的标准误 (\(S_b\)) 变大,导致 \(t\) 值变小。

- \(t\) 检验不准确,容易产生假阴性(误剔除重要变量)。

- 回归方程不稳定(数据微小变化导致系数剧烈变化)。

- 系数符号可能与实际经验相悖。

- 诊断:

- 相关矩阵:自变量间 \(r > 0.9\)。

- 容忍度 (Tolerance):\(Tol < 0.1\) 提示严重共线性。

- 方差膨胀因子 (VIF):\(VIF = 1/Tol\)。\(VIF > 10\) 提示严重共线性。

- 处理:剔除引起共线性的变量、合并变量、使用逐步回归。

例题:多重共线性的定义

多重线性回归分析中的共线性是指( )。

A. \(Y\)关于各个自变量的回归系数相同

B. \(Y\)关于各个自变量的回归系数与截距都相同

C. \(Y\)变量与各个自变量的相关系数相同

D. \(Y\)与自变量间有较高的复相关

E. 自变量间有较高的相关性

正确答案: E

解析: 共线性(多重共线性)是指模型中两个或多个自变量之间存在高度线性相关关系,而非自变量与因变量的关系。

例题:关于多重共线性

关于多重共线性,以下说法正确的是( )。

A. 逐步回归法有助于克服多重共线性。

B. 多重共线性会使得参数估计值的标准误变得很大,从而\(t\)值变得很小,使得\(t\)检验不准确,容易误将本应保留在模型的重要变量舍弃。

C. 多重共线性会使得回归方程不稳定,增加或减少某几个观察值可能会使得估计值发生很大变化。在多重共线性情况下,估计值的正负符号可能和客观实际不一致。

D. 如果方差膨胀因子=12,此时共线性严重。 。 E. 如果完全共线性存在,甚至无法得到参数的估计量。

正确答案: A, B, C, D, E

解析: A正确:逐步回归可以通过筛选变量排除共线性强的变量。 B、C正确:描述了共线性的典型危害(标准误膨胀、符号反转、不稳定)。 D正确:一般 \(VIF > 10\) 视为共线性严重。 E正确:完全共线性(自变量间完全线性相关)会导致矩阵不可逆,数学上无法求解参数。